Cómo los sesgos en la generación de imágenes con IA afectan a la diversidad visual. Estrategias prácticas para detectarlos y corregirlos, creando representacion

Más allá del prompt: responsabilidad visual

Generar imágenes con IA no consiste solo en elegir las palabras correctas, como expliqué en mi anterior post. Detrás de cada prompt hay un imaginario cultural que influye en los resultados. Si no somos conscientes de ello, el bias en Midjourney puede colarse en nuestras creaciones y dar lugar a representaciones poco diversas o poco realistas.

¿Qué es el bias en generación de imágenes?

Cuando hablamos de bias (o sesgo) en herramientas como Midjourney, nos referimos a una tendencia repetida en los resultados generados. En otras palabras, la IA no crea desde cero: interpreta los patrones que aprendió de millones de imágenes. Eso significa que, si en los datos predominaban ciertas representaciones, estas se repiten, aunque no sean la opción más justa o equilibrada. Por ejemplo, al pedir: "a doctor in a lab coats" es común que Midjourney muestre a un hombre de mediana edad como médico.

Eso es debido a que durante su entrenamiento, el modelo encontró mayor cantidad de fotografías de doctores hombres que de doctoras mujeres, y esa desproporción se refleja en las imágenes que genera.

El bias en la generación de imágenes no solo influye en profesiones, sino también en aspectos como:

-

Roles de género: asociar liderazgo a hombres y cuidados a mujeres.

-

Etnia y cultura: sobrerrepresentar personas blancas frente a otras etnias.

-

Edad: mostrar mayoritariamente personas jóvenes en contextos profesionales.

-

Estilo de vida: reforzar estereotipos sobre lo que significa “éxito” o “belleza”.

Detectar este fenómeno es fundamental porque condiciona la narrativa visual que estamos construyendo. Si no intervenimos, podemos estar reforzando estereotipos sin quererlo.

¿De dónde vienen esos sesgos?

Los sesgos no aparecen por casualidad. Tienen su origen en cómo se entrenan y ajustan los modelos de IA. En el caso de Midjourney, los principales factores son:

-

Datos de entrenamiento

Midjourney se nutre de millones de imágenes disponibles en Internet. Si en esos datos hay una representación desigual (por ejemplo, más fotos de hombres doctores que de mujeres), el sistema tenderá a replicar esa misma proporción. -

Optimización del modelo

Los algoritmos aprenden a generar lo que aparece con más frecuencia en sus datos de origen. Esto significa que, incluso sin intención, refuerzan ciertos patrones y dejan en segundo plano representaciones menos comunes. -

Lenguaje de los prompts

Las palabras importan. Términos como “businessman” refuerzan la imagen tradicional de un hombre en traje, mientras que opciones más neutras como “business professional” abren la puerta a resultados más diversos.

Cómo detectar bias paso a paso

-

Mira con atención: Genera varias imágenes a partir del mismo prompt. Analiza no solo la estética, sino quién aparece (género, edad, etnia, rol).

-

Cuenta resultados: Si de 20 imágenes de un ingeniero solo 2 son mujeres, hay un desequilibrio.

-

Apóyate en herramientas: Existen APIs y softwares de análisis que pueden identificar características como género, edad o etnia en imágenes, devolviéndote porcentajes.

Estrategias para mitigar sesgos

Detectar el problema es solo el primer paso; lo importante es aplicar soluciones concretas. Midjourney ofrece varias formas de ajustar los prompts y reducir los sesgos en las imágenes que generamos. Aquí tienes algunas estrategias efectivas:

- Usa lenguaje inclusivo: Las palabras importan. Cambiar “businessman” por “business professional” evita reforzar estereotipos y abre la puerta a representaciones más variadas.

- Pide diversidad: Si necesitas un grupo de personas, indícalo en el prompt: género, edad, etnias o incluso estilo de vestimenta. Midjourney tiende a seguir estas instrucciones con bastante fidelidad.

- Excluye estereotipos: Usa --no si tu versión de Midjourney lo permite. Si detectas que tu prompt siempre genera un mismo patrón (por ejemplo, “young white male”), puedes excluirlo.

- Cambia la semilla: Prueba con --seed 42 o --seed 99 para ver distintas variantes y escoger la más equilibrada.

- Combina descriptores positivos: Añadir términos como “diverse”, “inclusive”, “multiethnic” o “balanced” suele dar lugar a imágenes más variadas sin necesidad de alargar demasiado el prompt.

Buenas prácticas para un proceso transparente

Mitigar sesgos no es un esfuerzo aislado: debe convertirse en parte de tu flujo de trabajo creativo. Documentar y revisar lo que haces ayuda a mejorar la calidad y coherencia de los resultados. Aquí algunas recomendaciones:

-

Registra cada prompt:

Guarda siempre el texto exacto que usaste, incluyendo parámetros como --seed, --ar o --v 7. Esto permite repetir o ajustar resultados sin tener que improvisar de nuevo. -

Anota decisiones clave:

Si decidiste usar un --no para excluir un estereotipo o añadiste un descriptor como “diverse” o “inclusive”, apúntalo. Así tendrás claridad sobre por qué llegaste a cierta imagen. -

Crea un histórico de versiones:

Genera varias iteraciones de un mismo prompt y guárdalas con su semilla asociada. Esto facilita comparar y seleccionar las opciones más equilibradas. -

Involucra a diferentes perfiles:

La percepción de sesgos no siempre es evidente para todos. Pedir a colegas o colaboradores de distintos contextos que revisen tus imágenes puede aportar una mirada más amplia. -

Sé transparente en proyectos profesionales:

Si trabajas para clientes, documentar cómo ajustaste los prompts y qué medidas tomaste para evitar sesgos demuestra un compromiso con la ética visual. Esto suma valor a tu proceso creativo.

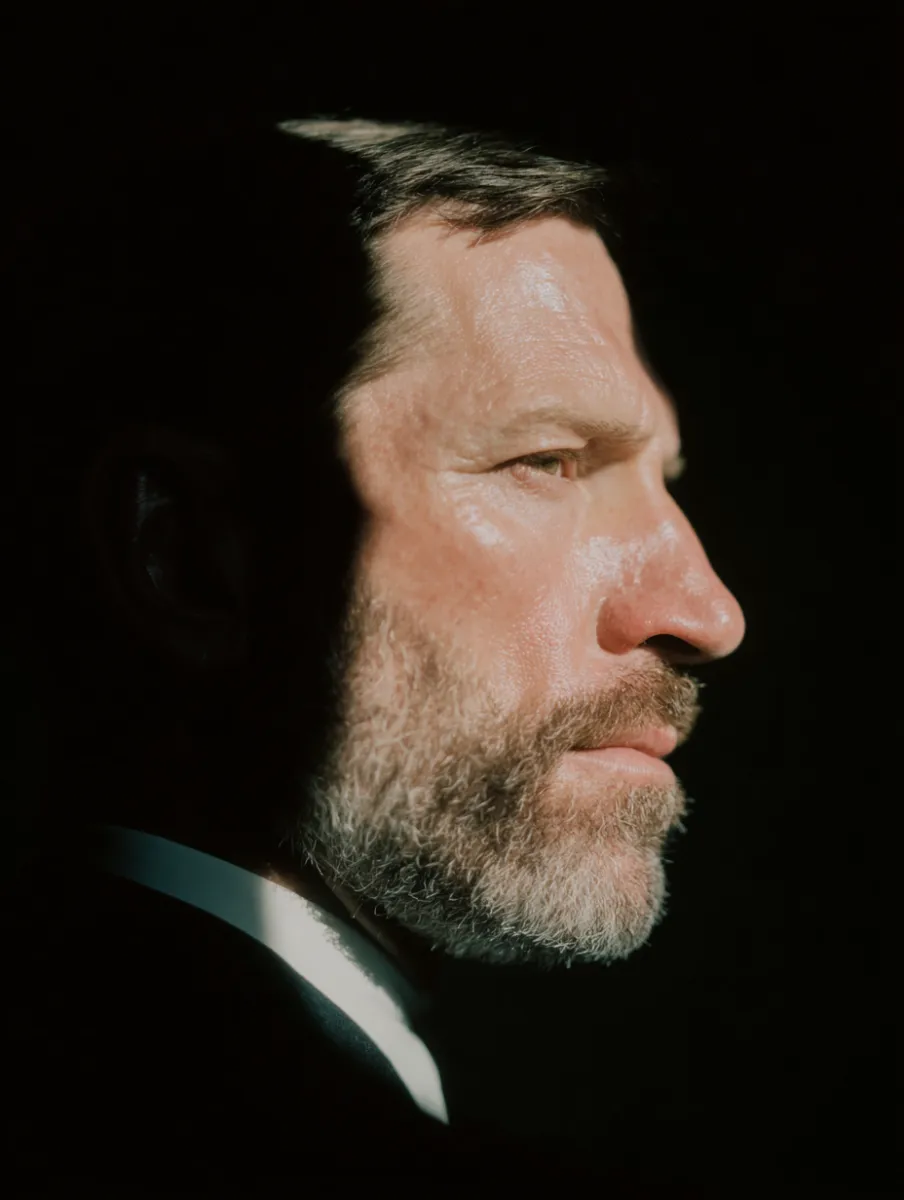

Caso de estudio breve

Antes:

/imagine "a CEO portrait" --v 7

⭢ 80 % hombres caucásicos.

Después:

/imagine "a CEO portrait of a 45-year-old Black woman, business suit, confident pose" --v 7 --ar 2:3

⭢ retrato profesional de mujer negra, equilibrado y representativo.

Ejemplos visuales comparativos

Para ilustrar el impacto de ajustar prompts y parámetros, aquí va una tabla donde puedas insertar capturas reales:

Conclusión

Ser conscientes de los sesgos en Midjourney es parte del proceso creativo. No se trata solo de generar imágenes bonitas, sino de crear representaciones más amplias, reales y respetuosas. Con pequeños ajustes en los prompts podemos hacer una gran diferencia y construir una narrativa visual más diversa e inclusiva. Cuanto más cuidamos lo que pedimos, más valor tienen las imágenes que obtenemos.

Una última recomendación: para generar imágenes con responsabilidad visual, vale la pena inspirarse en la campaña “Keep Beauty Real” de Dove. Allí encontrarás un enfoque práctico sobre cómo representar la diversidad y la belleza real, que puede servir como guía para crear prompts que generen imágenes más auténticas y equilibradas.

También te podrás descargar un manual con distintas palabras claves para generar mejores prompts.

¡La ética también mejora tu creatividad!

¿Y tú? ¿Has probado a revisar tus prompts con esta mirada más crítica?